原文链接及源码链接

原文:https://arxiv.org/abs/1807.04457

源码:https://github.com/LeMinhThong/blackbox-attack

以前的工作

Boundary Attack边界攻击,是基于边界上的随机游走。

以前工作的不足

需要大量查询,没有收敛保证。

提出的新方法

将硬标签黑盒攻击描述为一个实值优化问题,这个问题通常是连续的,可以用任何零阶优化算法来求解。

之前失败的原因

梯度不能通过反向传播直接计算;

由于只观察到硬标签判决,攻击目标函数变得不连续,输出是离散的,很难优化。

现在具体工作

开发了一个基于优化的框架,我们通过将硬标签黑盒攻击转化为一个新的实值优化问题,使硬标签黑盒攻击成为可能并提高查询效率,实值优化问题通常是连续的且更容易解决。此外,我们证明了只要边界光滑,通过仔细控制函数计算的数值精度,随机无梯度(RGF)方法可以收敛到固定点。

实验

MNIST、CIFAR和ImageNet上对硬标签黑盒CNN模型进行攻击.

硬标签(hard-label)黑盒攻击难度:

具体地说,攻击者只知道最终判决(TOP-1预测标签)而不是概率输出。

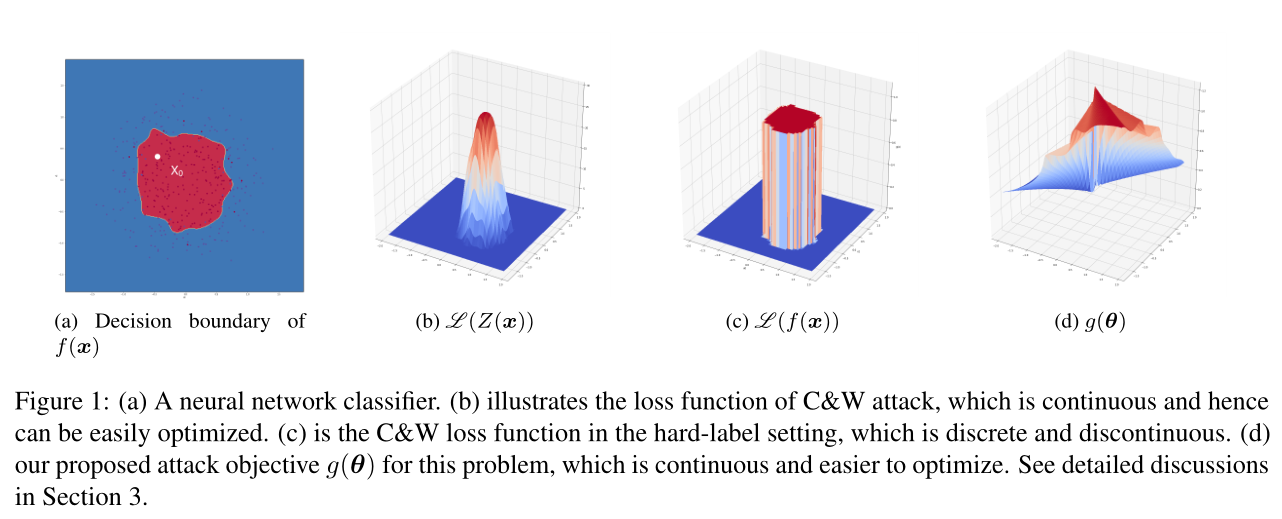

在这种情况下进攻是非常具有挑战性的。在图1a中,我们显示了一个简单的三层神经网络的决策边界。请注意,如图1b所示,因为logit层输出是实值函数,$\mathscr{L}(Z(\boldsymbol{x}))$项是连续的。但是,在硬标签黑盒设置中,只有$f(\cdot)$可用而$Z(x)$不可用。由于$f(\cdot)$只能是one-hot向量,如果将$f$带入损失函数,则$\mathscr{L}(f(\boldsymbol{x}))$(如图1c所示)将是不连续的并且具有离散的输出。

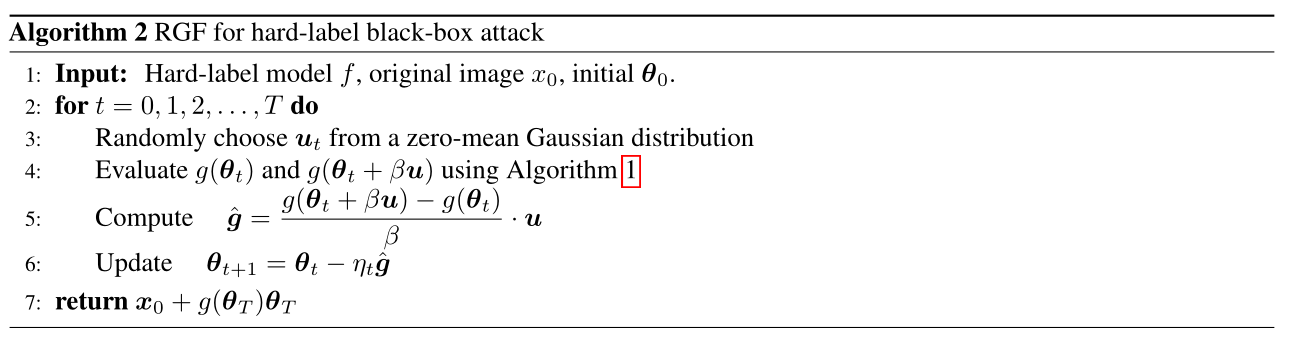

算法:

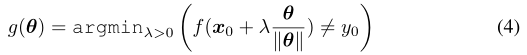

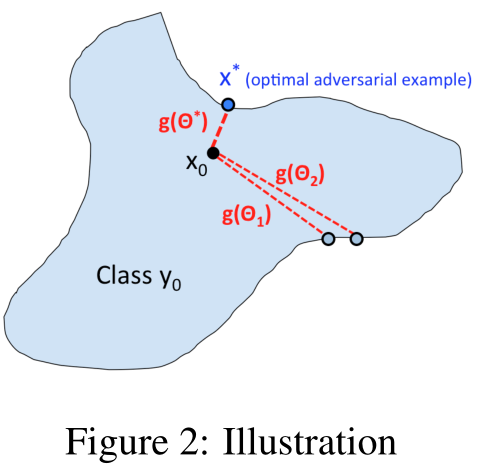

对于一个给定的样本$x_{0}$、真实的标签$y_{0}$、硬标签黑盒函数$f: \mathbb{R}^{d} \rightarrow\{1, \ldots, K\}$,我们根据攻击类型定义了目标函数$g: \mathbb{R}^{d} \rightarrow \R$。

非定向攻击:

定向攻击(给定目标t):

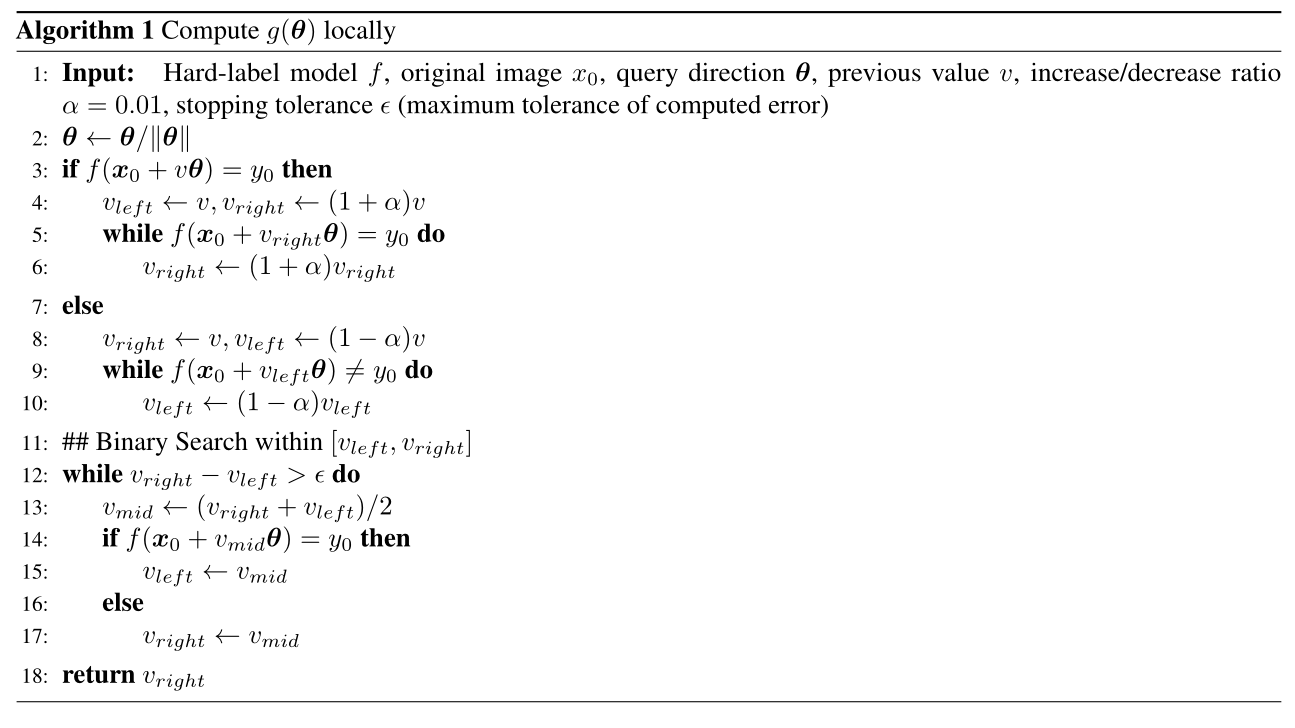

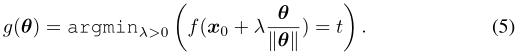

在这个公式中,θ表示搜索方向,g(θ)是沿θ方向从$x_{0}$到最近的对抗性样本的距离。对于无目标攻击,g(θ)也对应于沿$\theta$方向到决策边界的距离。在图像问题中,f的输入域是有界的,因此我们将在(4)和(5)的定义中添加相应的上下界。

不搜索对抗性样本,而是搜索方向θ来最小化失真g(θ),这个导致了以下优化问题:

最后,通过 找到对抗样本,其中$θ^{*}$是(6)的最优解。

找到对抗样本,其中$θ^{*}$是(6)的最优解。

注意!与C&W或PGD目标函数不同,C&W或PGD目标函数在硬标签设置中是不连续的阶跃函数(见第2节),但是Opt-Attack中的g(θ)将输入方向映射到实值输出(到决策边界的距离),这通常是连续的,θ的微小变化通常会导致g(θ)的微小变化,如图2所示。

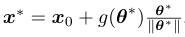

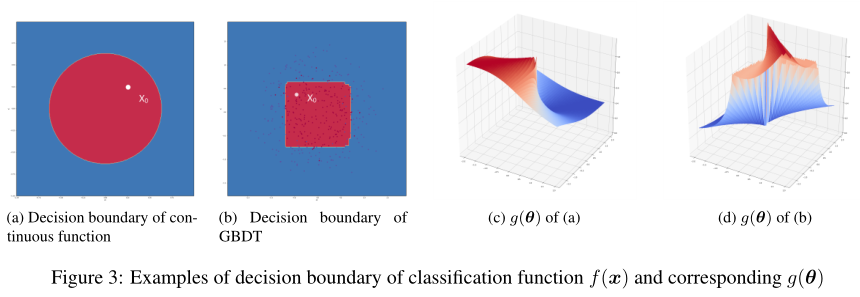

举例:定义在二维输入空间中的f(x)及其对应的g(θ)的三个例子。在这种情况下,如图3c所示,g(θ)是连续的。此外,在图3b和图1a中,我们显示了GBDT和神经网络分类器生成的决策边界,这两个边界不是连续的。然而,如图3d和图1d所示,即使分类器函数不是连续的,g(θ)仍然是连续的。这使得应用零阶法求解(6)变得容易。

在这里,对于g(θ)函数,我们不能求g的梯度,但是可以对原始函数f使用硬标签查询来计算g(θ)的近似函数值。

g(θ)函数值的求法:通过细粒度搜索找到边界的大概区域,然后通过二分查找在该区域中找到近似解。

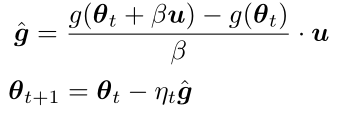

零阶优化:对于只能求函数值而不能求梯度的最佳化问题,可以自然地应用零阶优化算法。 在这里,作者建议使用文献[2,18]中提出的随机无梯度(RGF)方法来求解方程(1)。

综上: